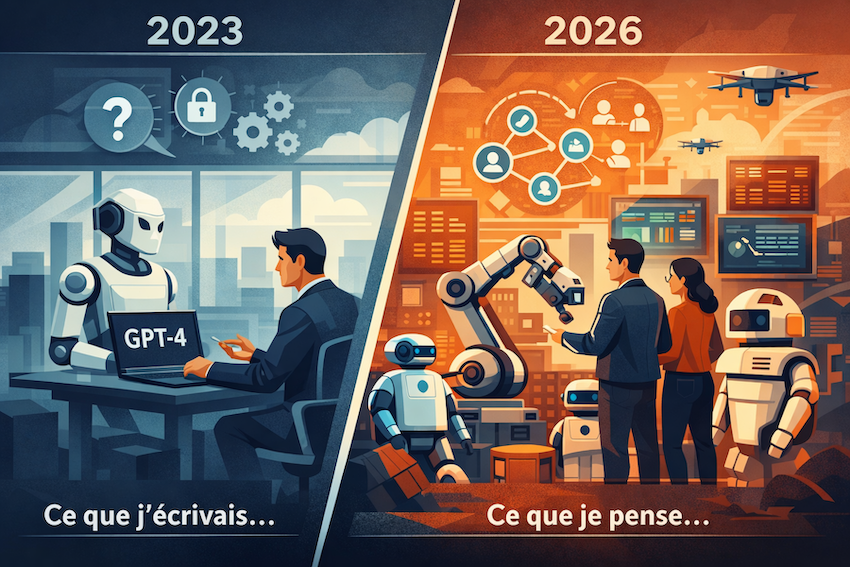

En septembre 2023, je publiais sur ce blog un dossier en cinq parties sur l’intégration de l’IA en entreprise. Je l’avais co-écrit avec GPT-4 — ce qui était déjà, à l’époque, une façon de pratiquer ce dont je parlais.

Deux ans et demi ont passé. Le marché a bougé vite. Mes convictions aussi, un peu. Voici ce qui a tenu, ce qui a changé, et ce que j’observe maintenant.

Ce qui a tenu

La thèse centrale du dossier était que l’impact de l’IA sur les entreprises est d’abord organisationnel, pas technique. Que les vrais blocages ne sont pas dans les modèles mais dans les circuits d’information rigides, les silos décisionnels, les organisations qui n’ont pas été conçues pour traiter de l’information en temps réel.

Cette thèse est encore plus vraie aujourd’hui. Deux ans de déploiements en entreprise l’ont largement confirmée. Les organisations qui ont le mieux tiré parti de l’IA ne sont pas celles qui ont choisi le meilleur outil — ce sont celles qui avaient déjà une culture de la donnée, une chaîne d’information fluide, et des décideurs capables d’itérer vite. L’IA n’a pas changé cette équation, elle l’a accentuée.

J’écrivais aussi que « les technologies apportent des capacités de traitement phénoménales, mais ne sont pas en soi des sources d’innovation et de créativité — elles n’ont pas ces caractéristiques humaines que sont la curiosité, le besoin d’expérimenter sans objectif précis a priori. » Je maintiens chaque mot.

Ce qui a changé

Le marché des modèles s’est radicalement reconfiguré.

En 2023, GPT-4 était l’horizon. Le débat était : OpenAI ou les quelques alternatives (Anthropic, Cohere, AI21) qui se positionnaient comme plus sûres ou plus spécialisées. En 2026, ce débat est dépassé. L’open source a explosé — Llama, Mistral et leurs dérivés ont rendu accessibles des modèles de très bon niveau que n’importe quelle organisation peut déployer sur sa propre infrastructure. Les coûts d’inférence se sont effondrés.

Ce changement a une conséquence directe pour les praticiens : il est désormais possible de faire tourner des modèles performants en local, sur sa propre machine, sans envoyer de données à un tiers. J’expérimente ces modèles locaux depuis plusieurs mois — Llama, Mistral et leurs dérivés en tête. Ce qui m’a frappé, c’est moins la performance brute que la légèreté : des modèles de quelques gigaoctets qui tiennent sur un laptop standard et qui résolvent 80% des cas d’usage courants avec une vélocité remarquable. La confidentialité des données, la latence quasi-nulle, l’absence de coût d’inférence — ces caractéristiques changent profondément ce qu’il est possible de faire au quotidien, en mission comme en dehors. Ce n’est plus de la R&D, c’est de l’outillage opérationnel.

Ce changement a une deuxième conséquence : la question n’est plus « faut-il faire de l’IA ? » mais « comment industrialise-t-on ce qu’on a expérimenté ? » La plupart des grandes entreprises ont leurs POC, leurs pilotes, leurs champions internes. Le chantier de 2026, c’est le passage à l’échelle — et c’est là que les problèmes organisationnels que j’identifiais en 2023 ressurgissent avec force. ¹

Les agents IA changent la nature de ce qu’on déploie.

En 2023, on parlait essentiellement d’assistance et de génération de contenu. Depuis, les architectures agentiques — des systèmes capables de planifier, d’enchaîner des actions, d’utiliser des outils de façon autonome — ont mûri au point d’entrer dans les usages professionnels réels. Ce n’est plus « l’IA rédige à ma place », c’est « l’IA orchestre un flux de travail pendant que je supervise ». Selon Gartner, 40% des applications d’entreprise intégreront des agents IA spécifiques d’ici fin 2026, contre moins de 5% aujourd’hui — et d’ici 2028, les écosystèmes d’agents collaboreront dynamiquement entre eux à travers plusieurs applications et fonctions métier. ²

Ces architectures agentiques ne se limitent d’ailleurs plus aux systèmes purement logiciels. La robotique est en train de vivre sa propre révolution sous l’impulsion de l’IA : des robots capables d’apprendre à manipuler des objets réels, à naviguer dans des environnements non structurés, à intervenir là où c’est dangereux ou répétitif — ce que certains appellent la « Physical AI ». Pour l’industrie, la logistique, la maintenance, c’est une transformation silencieuse mais massive qui ouvre des terrains d’application entièrement nouveaux. Ce sujet est particulièrement central face à l’impératif de réindustrialisation qui devient incontournable en Europe et en France — la capacité à produire localement, à maîtriser des chaînes de fabrication complexes, à réduire les dépendances critiques repose de plus en plus sur la combinaison robotique-IA. Et au fond, c’est une question de souveraineté : souveraineté industrielle, souveraineté technologique, souveraineté sur les données qui alimentent ces systèmes. Les nations et les entreprises qui maîtriseront ces briques — modèles, agents, robots, données — seront en position de force. Les autres subiront.

Pour les managers de transformation, qu’il s’agisse de systèmes logiciels ou physiques, cela pose la même question nouvelle et concrète : comment gouverner un système qui agit, pas seulement qui répond ? À titre personnel, j’ai franchi le pas récemment sur mes projets d’électronique : je pilote désormais mes réalisations maker grâce à un agent sur Claude qui gère simultanément mon inventaire de composants électroniques, le montage électronique, le code embarqué et l’interface utilisateur. Ce qui était auparavant quatre tâches séquentielles et souvent fastidieuses devient un flux orchestré. C’est une démonstration à petite échelle de ce que les architectures agentiques changent concrètement — et une excellente façon de comprendre, de l’intérieur, ce qu’on va demander aux organisations de déployer à grande échelle.

La supervision humaine, la traçabilité des décisions, la définition des périmètres d’autonomie — ce sont les chantiers qui arrivent, et ils sont organisationnels avant d’être techniques.

À cela s’ajoute un cadre réglementaire qui s’impose : l’AI Act européen entre pleinement en vigueur en août 2026. Comme le RGPD en son temps, il va structurer les pratiques bien au-delà des frontières de l’Union — classification des risques, gouvernance, responsabilité des systèmes. Pour les directions d’entreprise, c’est une contrainte mais aussi un signal de maturité : les acteurs qui auront mis leur maison en ordre avant l’échéance en feront un avantage compétitif.

La question du contrôle est devenue centrale.

En 2023, le débat public était surtout sur les biais et la désinformation. En 2026, la question qui préoccupe vraiment les organisations est plus prosaïque : comment garder la main sur ce que l’IA fait en mon nom ? Validation humaine, traçabilité des décisions, gouvernance des prompts — des sujets qui n’existaient pas comme tels il y a deux ans et qui sont devenus des chantiers à part entière.

Ce que j’observe sur le terrain

Sans entrer dans des détails de mission, quelques constats récurrents.

L’IA révèle les organisations, elle ne les transforme pas seule. Là où la chaîne de décision est fluide et les équipes habituées à itérer, l’IA accélère fortement. Là où les silos sont durs et la culture de la preuve absente, elle crée surtout de la friction — parce qu’elle force des questions sur la donnée, la propriété de l’information, la responsabilité des décisions que personne n’avait envie de poser.

Le vrai différenciateur n’est pas l’outil, c’est la méthode de travail. Les équipes qui obtiennent les meilleurs résultats ne sont pas forcément celles qui utilisent les modèles les plus puissants. Ce sont celles qui ont développé une discipline : définir précisément le problème avant de prompter, valider systématiquement les outputs, intégrer l’IA dans un flux de travail pensé plutôt que de l’utiliser en one-shot.

La résistance humaine reste le facteur limitant principal. Pas la résistance au changement au sens vague du terme — la résistance très concrète des personnes dont le travail consiste à « savoir des choses » et qui perçoivent l’IA comme une menace directe sur leur valeur. Les experts métier, les juristes, les analystes financiers. Le McKinsey Global Institute le confirme : les gains de l’IA ne se concrétisent que pour les organisations qui investissent massivement dans la montée en compétences — les collaborateurs doivent apprendre à formuler des instructions précises, comprendre les limites des modèles, vérifier systématiquement les outputs. ³ Mais la formation seule ne suffit pas. Ce que j’observe en mission, c’est que le management — et en particulier le middle management — joue un rôle absolument déterminant. Là où il est embarqué et aligné, l’adoption se fait. Là où il est contourné, mal informé ou simplement passif, il devient un verrou. Pas par mauvaise volonté : parce que l’IA remet en question son rôle de filtre et de traducteur de l’information, ce qui est une menace réelle sur son positionnement. Gérer cette dimension reste le vrai travail de la transformation — l’IA ne change rien à cela.

Les gains les plus rapides et les plus solides sont sur les tâches à fort volume, fort risque d’erreur et faible valeur ajoutée. Sur ma mission récente chez Omnes Education, nous avons mis en pratique cette logique sur deux types de chantiers concrets. D’un côté, l’automatisation de traitements administratifs répétitifs — retraitements de notes, traitements de fichiers de données — qui concentraient un volume important d’interventions manuelles, donc de risques d’erreur et de temps perdu. De l’autre, la gestion du knowledge management : mettre à disposition des utilisateurs une documentation exploitable, à jour, accessible en langage naturel plutôt qu’enfouie dans des dossiers partagés. Sur le seul chantier de l’automatisation des actes administratifs, le gain mesuré a été équivalent à 2 ETP sur la durée de la mission. Ce n’est pas un chiffre de présentation : c’est une capacité opérationnelle réorientée vers des tâches à valeur ajoutée. C’est là, sur ces chantiers peu glamour, que l’IA délivre le plus sûrement en entreprise.

Ce dont les organisations vont avoir besoin

Si je devais identifier la compétence la plus rare et la plus demandée dans les deux années qui viennent, ce n’est pas le prompt engineering ni la maîtrise d’un outil en particulier. C’est la capacité à lire une organisation de façon holistique — comprendre simultanément ses dimensions humaines, IT et business — et à concevoir des systèmes qui tiennent sur ces trois couches en même temps. L’IA multiplie les options et accélère l’exécution, mais elle ne remplace pas le jugement architectural. Elle l’exige davantage.

S’ajoute à cela un contexte qui rend l’exercice encore plus difficile : il est devenu très difficile de lire l’avenir. L’IA chahute les pratiques, les marchés, les modèles économiques à une vitesse que peu d’organisations savent absorber. Et le contexte géopolitique — qui redessine les chaînes d’approvisionnement, les règles du commerce international, les équilibres entre acteurs technologiques — ajoute une couche d’incertitude que les outils classiques de planification stratégique ne savent pas traiter.

Ce dont les entreprises ont besoin, ce ne sont pas des spécialistes IA de plus. Ce sont des profils capables de naviguer dans cette incertitude, de maintenir une direction sans prétendre avoir toutes les réponses, et de concevoir des organisations suffisamment adaptables pour changer de cap quand c’est nécessaire. C’est moins une question de technologie que de posture.

Ce que je ferais différemment dans le dossier original

Je l’aurais ancré davantage dans des cas concrets (il en existait peu alors !). La partie la plus lue, la plus citée, était la plus abstraite — les grands enjeux stratégiques, la destruction créatrice, Schumpeter. Ce qui aurait eu plus de valeur durable, c’est la partie terrain : que se passe-t-il vraiment dans une direction métier qui essaie d’intégrer un LLM dans son workflow ? Quels sont les trois premiers blocages qu’elle rencontre, dans l’ordre ?

C’est la question à laquelle je m’efforce de répondre maintenant — par l’écriture sur ce blog, et par la pratique directe dans mes missions et mes projets personnels.

Le dossier original reste accessible ici : Comprendre et bien intégrer l’IA pour transformer les entreprises →

Sur le versant making et prototypage que j’évoque ici : Toysfab →

Sources

¹ KPMG, Global Tech Report 2026, février 2026 — kpmg.com

² Gartner, Predicts 40% of Enterprise Apps Will Feature Task-Specific AI Agents by 2026, août 2025 — gartner.com

³ McKinsey Global Institute, A new future of work: The race to deploy AI and raise skills in Europe and beyond, mai 2024 — adapté pour la France par l’Institut de l’Entreprise, décembre 2024 — institut-entreprise.fr